Её утешают, а шарик летит…

Булат Окуджава

Наполненные гелием воздушные шары в моём детстве были редкостью и завораживали нас своим стремлением ввысь. Теперь, конечно, ими никого не удивишь, но всё равно грустно смотреть вслед упущенному и стремительно взмывающему вверх шару. Самое время поразмыслить о случайности и закономерности.

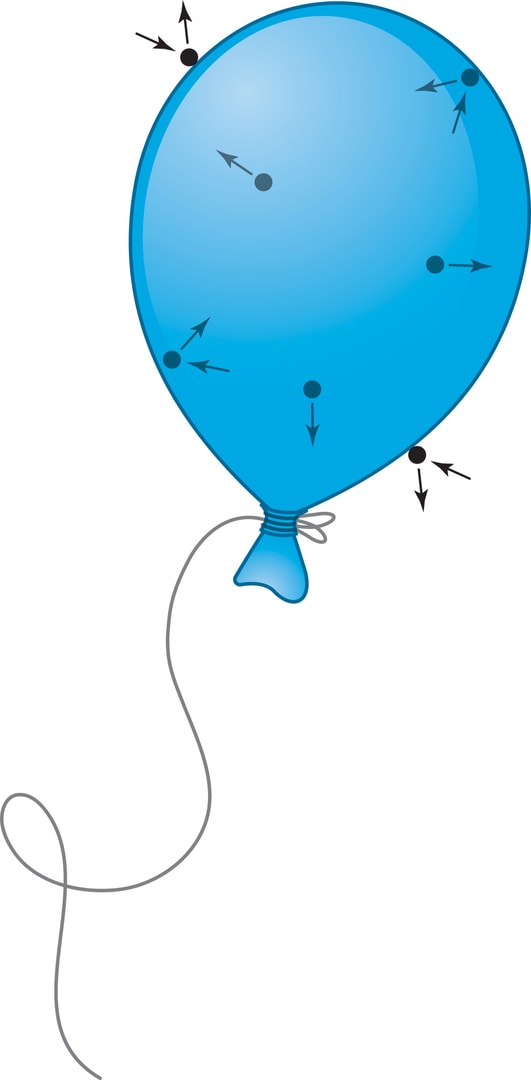

Закономерность, о которой мы будем говорить, не в том, что вечно приключается что-нибудь нежелательное: шарик улетает, автобус опаздывает, мяч пролетает мимо ворот и т. д. Удивительная закономерность в том, что такая сложная система, как воздушный шар, в целом хорошо описывается простым законом Архимеда из III века до нашей эры: чтобы удержать шар в равновесии, к нитке должна быть приложена сила, равная разности веса воздуха и гелия в объёме шара. Не будет этой силы, и шар начнёт ускоряться вверх.

Ну и что же в этом удивительного? А то, что перед нами взаимодействие бесчисленного числа молекул газа (гелия — внутри шара, азота и кислорода — снаружи) с огромным числом молекул полимеров, из которых сделаны сам шар и то, чем он завязан (нитка). Хотя газы и гораздо проще полимеров, всё равно хоть сколько-нибудь детальное понимание их физики возникло только в XIX веке, а многие вопросы и до сих пор занимают физиков, особенно математических. Вспомнив число Авогадро и найдя в интернете значение молярной массы воздуха, заключаем, что в 29 граммах воздуха содержится около $6\cdot10^{23}$ молекул. И ведь каждая из них куда‐то летит, вращается, вибрирует, сталкивается с другими молекулами — состояние, полагаю, в чём-то хорошо знакомое каждому из нас. Но глядя на такую огромную систему в целом, мы видим действия законов физики для газов, функционирование экономики в обществе и бесчисленное множество других проявлений законов больших чисел, когда макроскопическая закономерность возникает из микроскопической случайности. Взять, к примеру, форму воздушного шара: без чувствительных приборов она будет казаться нам гладкой поверхностью, не меняющейся во времени, словно это чистая математическая идея, а не что-то, состоящее из сложных полимерных молекул.

Глядя на газ, математический физик, т. е. человек, изучающий математические модели физических явлений, не следит за каждой отдельной молекулой, а описывает происходящее в терминах средних значений всевозможных наблюдаемых величин по какой-то области в пространстве и/или времени. Например, классическая тройка $$ (\rho,p,T)=(\hbox{плотность}, \hbox{давление}, \hbox{температура}) $$

отражает соответственно среднее число частиц на единицу объёма, средний импульс, который частицы передают действительным или воображаемым стенкам, и среднюю кинетическую энергию их движения. (Конечно, речь идёт об абсолютной температуре, т. е. температуре, отсчитываемой от абсолютного нуля, а не о шкалах Цельсия или Фаренгейта, которые отличаются от неё на преобразование вида $x\mapsto a x + b$.)

В принципе, можно было бы рассмотреть какой-то более длинный набор средних $$ \vec \sigma = (\rho,p,T,…), $$

но для такой системы, как газ, уже две величины $p$ и $T$ (именно их передаёт прогноз погоды) определяют все остальные средние. Иными словами, некоторые уравнения (их называют уравнениями состояния) сводят все мыслимые средние $\vec \sigma (x)$ по маленькой окрестности какой-то точки $x$ к конечному набору величин, таких как $p$ и $T$.

Это совершенно замечательный факт, но мы сейчас не будем на нём задерживаться. Вместо этого спросим себя: как эти средние $\vec \sigma (x)$ могут меняться от точки к точке внутри какой‐то системы $\Omega$, например внутри воздушного шара? Закономерность, о которой пойдёт речь, состоит в том, что распределение $\vec \sigma (x)$ в $\Omega$ также подчинено очень жёстким уравнениям. Любое состояние, не удовлетворяющее этим уравнениям, будет невероятно в том смысле, что вероятность его реализации будет совершенно ничтожна по всем разумным меркам.

Вероятность — это очень важное и сложное понятие, но при первом ознакомлении (да и в конечном итоге) его можно представлять себе так. Если у нас есть 1000 равновероятных возможных исходов и только в трёх из них происходит какое-то событие, то вероятность этого события есть 0,003. Легко поверить, что у такого рода дискретного подсчёта есть непрерывный аналог, при котором вероятность того, что случайное вещественное число $х$ между 0 и 10 окажется меньше $π$, есть 0,314159… Всё непрерывное можно сколь угодно хорошо приблизить дискретным, и если отрезок от 0 до 10 разделить на миллион равных частей, то непрерывное событие $\{ x < π \}$ можно приблизить событием $\left\{ x \le \frac{314159}{100000}\right\}$. Для понимания сути обсуждаемых нами явлений разница между дискретным и непрерывным не существенна. Будем считать, что координаты и все другие параметры, описывающие движение молекул, округляются с точностью до какого-то очень маленького числа $\varepsilon$ и поэтому принимают какое-то гигантское, но конечное число возможных значений. В частности, на некоторой очень малой шкале, сравнимой с $\varepsilon$, мы можем наблюдать только конечное число состояний. Кстати, совсем необязательно предполагать, что все эти элементарные состояния равновероятны, просто надо считать их вклад в вероятность с соответствующими весами. Ни одно из последующих рассуждений от этого не изменится.

Как нам оценить вероятность увидеть состояние газа в области $\Omega$ с заданными $\vec \sigma(x)$? Мысленно разобьём нашу область $\Omega$ на большое число подобластей $\Omega_i$. Пусть, с одной стороны, $\Omega_i$ так малы, что координаты $x$ и функции $\vec \sigma(x)$ в них можно считать постоянными, а с другой стороны, в молекулярном масштабе так велики, что происходящее внутри одной из них мало влияет на остальные. В воздухе, например, молекулы сталкиваются, пролетев порядка $10^{-8}$ метра, а на много бóльших расстояниях ведут себя практически независимо. Что значит независимо? Это значит, что число возможных микроскопических состояний системы есть, в главном приближении, произведение числа всех возможных состояний подсистем в каждой $\Omega_i$. Тут удобно взять от всего логарифмы, ибо логарифмы переводят произведения в суммы. Получим $$ \ln \mathop{\rm P}\nolimits(\hbox{увидеть } \vec\sigma(x) \hbox{ в } \Omega) ≈ \sum\limits_{i=1}^N S(\Omega_i,\vec\sigma(x_i)) - C, $$

где $S(\Omega_i,\vec\sigma(x_i))$ есть логарифм числа состояний внутри $\Omega_i$ с заданным значением $\vec\sigma$ в какой-то точке $x_i\in \Omega_i$, а постоянная $C$ не зависит от $\vec\sigma(x)$ и есть логарифм числа всех вообще возможных состояний системы. В статистической физике логарифм числа возможных микроскопических состояний при заданном макроскопическом называется энтропией, это очень важное понятие.

Каждую из подобластей $\Omega_i$ можно ровно так же измельчать дальше. Поскольку функция $\vec\sigma$ уже практически постоянна в $\Omega_i$, это не даст ничего принципиально нового, и, значит, $S(\Omega_i,\vec\sigma(x_i))$ прямо пропорциональна объёму $|\Omega_i|$ области $\Omega_i$. Чтобы найти коэффициент пропорциональности, вспомним, что по нашему предположению логарифм числа состояний в кубике $❒$ с центром $x_i$ и стороной $\varepsilon$ конечен и равен какому‐то числу $S(x_i, \vec\sigma(x_i)):=S(❒, \vec\sigma(x_i))$. Поэтому $$ S(\Omega_i,\vec\sigma(x_i)) = \frac{|\Omega_i|}{\varepsilon^3}\> S(x_i,\vec\sigma(x_i)). $$

Математики давно поняли важность операции суммирования какой-нибудь функции по всё более мелким разбиениям какой-нибудь области $\Omega$ и придумали ей специальное название — интеграл. По определению интеграла $$ \int\limits_{\Omega} S(x,\vec\sigma(x)) dx = \lim \sum\limits_i S(x_i,\vec\sigma(x_i)) |\Omega_i| , $$

где предел берётся по измельчениям разбиений и $x_i \in \Omega_i$. Для краткости будем иногда сокращать это обозначение до $\int\limits_\Omega S dx$.

Собирая всё вместе, мы получаем, что $$ \ln \mathop{\rm P}\nolimits(\hbox{увидеть } \vec\sigma(x) \hbox{ в } \Omega) \propto \exp \left(\frac{1}{\varepsilon^{3}} \int\limits_{\Omega} S d x\right) = \exp \left(\frac{1}{\varepsilon^{3}}\right) ^ { \int\limits_{\Omega} S d x } $$

где знак $\propto$ читается «пропорциональна», а коэффициент этой пропорциональности подбирается так, чтобы сумма всех вероятностей равнялась единице. Вдумаемся в эту формулу. Она говорит, что вероятности различных состояний системы различаются на некоторую степень числа $\exp\Bigl(\frac1{ \varepsilon^3}\Bigr)$, где $\varepsilon$ — это размер слабо взаимодействующих подсистем, на которые наша система может быть разбита. Прикиньте, о какого размера числе мы говорим для кубометра воздуха, это совершенно гигантское число! Поэтому вероятность увидеть любое состояние, для которого интеграл $\int\limits_{\Omega} S dx$ не максимален, абсолютно ничтожна, этого не случится никогда. И всегда случится то состояние $\vec\sigma(x)$, при котором этот интеграл достигает максимума. Условие максимума $\int\limits_{\Omega} S(x,\vec \sigma(x)) dx$ есть обещанное уравнение на распределение $\vec \sigma(x)$ внутри $\Omega$.

Раздел математики, занятый поиском максимумов интегралов, называется вариационным исчислением. Он возник давно и оказался очень полезен, например, в решении задач классической механики и классической теории поля. Вслед за Лагранжем, уравнения движения ньютоновой механики и всех аналогичных ей наук можно переписать как уравнения на максимум некоторого интеграла. Мы только что видели, что подобное описание может быть получено не аксиоматически, а исходя из микроскопических принципов. (По очень похожей схеме можно вывести классическую механику из квантовой механики, роль величины $\varepsilon^3$ будет играть постоянная Планка.) То, что классическая механика считает условием равновесия, статистическая механика интерпретирует как условие оптимальности, условие максимизации вероятности случиться.

Принципиальную важность этого принципа для статистической механики можно сравнить с ролью эволюционного подхода к задачам биологии. Эволюция сама чётко отбирает самые жизнестойкие из всего великого множества биологических форм; совершенно аналогично, статистическая физика отбрасывает все варианты, кроме самого вероятного. Разумеется, законы физики и химии лежат в основе функционирования живой природы, и это сравнение не более чем попытка приблизить законы микромира к нашей жизненной интуиции. Однако подобного рода организующие принципы чрезвычайно важны для работы учёных, и, я надеюсь, читатель задумается о том, как много вокруг нас объясняется тем, что наш мир есть самый случайный из всех возможных миров.

На самом деле в наших выводах мы слегка забежали вперёд. Не может быть, чтобы разные подобласти $\Omega_i$ были совершенно независимы, ибо если масса и энергия заперты в нашей системе, то для них должны выполняться законы сохранения. Это означает, что максимум мы ищем не среди всех возможных $\vec\sigma(x)$, а только среди тех, для которых фиксирована $$ \hbox{суммарная энергия} = \int\limits_\Omega E(x) dx , $$

где $E(x)$ есть плотность энергии, одно из средних в наборе $\vec\sigma(x)$. Аналогично могут быть введены другие ограничения на $\vec\sigma(x)$: например, если на стенках контейнера поддерживается заданная температура, то возникают граничные условия. Вариационное исчисление умеет справляться с поиском такого рода условных максимумов. Если читатель умеет решать задачи на максимум, то очень рекомендую ему сесть и проверить, что распределение энергии по системе оптимально, если $$ \frac{\partial S(x,\vec\sigma(x))}{\partial E} = \hbox{одна и та же постоянная для всех } x \in \Omega. $$

А тем, кого подобные задачи пока ещё смущают, объясню этот ответ. Давайте мысленно переместим очень малое количество энергии $\delta E$ из точки $x_1\in \Omega$ в точку $x_2\in \Omega$. Как изменится при этом $\int\limits_{\Omega} S(x,\vec\sigma(x)) dx$? Понятно, что на величину порядка $\delta E \>\Bigl( \frac{\partial S(x,\vec\sigma(x))}{\partial E(x)} {\Big|_{x=x_2}} - \frac{\partial S(x,\vec\sigma(x))}{\partial E(x)} {\Big|_{x=x_1}} \Bigr)$, которая не может быть ни положительной, ни отрицательной, если распределение энергии оптимально. Значит, эта величина равна нулю, что и есть условие постоянства $\frac{\partial S(x,\vec\sigma(x))}{\partial E}$. Кстати, та же самая математическая задача об оптимальном распределении ресурса, суммарное количество которого фиксировано, встречается в массе других контекстов, включая например математическую экономику. Продумав эту задачу единожды, читатель сэкономит себе много времени в будущем.

На самом деле постоянная $\frac{\partial S(x,\vec\sigma(x))}{\partial E}$ есть величина, обратная температуре. С микроскопической точки зрения равенство $$ \frac{1}{\hbox{температура}}=\frac{\partial S(x,\vec\sigma(x))}{\partial E} $$

есть просто определение температуры. В самом деле, величина $\Big(\frac{\partial S}{\partial E}\Big) {\vphantom{\frac12}}^{-1}$, во-первых, постоянна по любой равновесной системе, во-вторых, измеряется в единицах энергии и, в-третьих, совпадает с классическим определением температуры для идеального газа с точностью до системы единиц.

Энергия универсальна, и все её формы могут превращаться друг в друга. Реальное или, по крайней мере, воображаемое взаимодействие любых двух физических систем, при котором происходит обмен энергией, позволяет, выбрав шкалу температур, скажем, для воздуха, перенести её на другие системы.

А вот ещё одно простое следствие наших формул и нового определения температуры через производную энтропии по энергии. Рассмотрим маленькую подсистему $\Omega_i$ внутри всей большой системы $\Omega$. Она может быть настолько мала, что мы можем считать её одним из наших кубиков $❒$. Подсистема $\Omega_i$ может обмениваться энергией с остальной системой $\Omega\setminus \Omega_i$, поэтому её энергия $E_i$ не фиксирована. То, что подсистема приобретает, остаток системы теряет, и, в частности, если в наш кубик $❒$ добавится какая-то энергия $\delta E$, то, по формулам, которыми мы только что пользовались, состояние в $\Omega\setminus \Omega_i$ потеряет $$ {\exp\Bigl(-\delta E \> \frac{\partial S}{\partial E}\Bigr) = \exp\Bigl(-\frac{\delta E}{T}\Bigr)} $$

общим множителем в своей вероятности. Вывод: если энергия $E_i$ внутри $\Omega_i$ не фиксирована, а определяется равновесием с огромной внешней системой температуры $T$, то это даёт множитель $\exp\Bigl(-\frac{E_i}T\Bigr)$ в распределение вероятностей внутри $\Omega_i$. Это называется распределением Гиббса. Совершенно замечательна универсальность множителя $\exp\Bigl(- \frac ET\Bigr)$. Действительно, для любой системы мы всегда можем предположить существование значительно большей объемлющей системы, и любые две системы, в принципе, можно привести в независимый контакт с этаким гигантским общим резервуаром энергии.

Кстати, очень часто функция $S(x,\vec\sigma(x))$ не зависит явно от координаты $x$, и максимум интеграла часто достигается на постоянной функции $\vec\sigma(x) = \vec\sigma_{\mathrm{макс}}$. И действительно, если к системе не приложено внешних сил, естественно ожидать, что температура и давление в ней выравняются. Причём выравнивание это произойдёт исключительно быстро, что можно увидеть, оценив вероятность наблюдать заданные значения $\vec\sigma(x,t)$ как функцию и координаты $x$, и времени $t$.

Что же касается нашего воздушного шара, то тут внешние силы как раз приложены, а именно тяготение Земли. Неравномерностями процессов нагрева атмосферы в этих масштабах можно пренебречь, так что температуру мы будем считать постоянной, а вот давлению придётся зависеть от $x$. Легко поверить и легко проверить, что равновесие статистическое воспроизведёт условие равновесия механического — давление на разных высотах $h_1$ и $h_2$ должно отличаться ровно настолько, чтобы поддерживать вес газа между $h_1$ и $h_2$. Кстати, заинтересованный читатель легко выведет из этого факта и уравнение состояния $$ p=\hbox{const} \rho T $$

для идеального газа, и что с увеличением высоты на интервалах, где температура почти не меняется, давление и плотность газов в атмосфере падают экспоненциально.

Мы не будем в это углубляться, а просто заметим, что гелий легче воздуха. Поэтому давление в нём убывает с высотой медленнее, чем в воздухе. Значит, никак невозможно уравновесить давление внутри и вне гелиевого шара в поле тяжести Земли. Следовательно, молекулы газа будут сообщать ненулевой суммарный импульс молекулам полимера в шаре, а те, в свою очередь, через свою сложную статистическую механику, передадут эту силу полимерам в нитке и, в конце концов, нашему телу и нервным окончаниям в нём. Захватывающая картина! Столько всего интересного в математической физике, уже и не так жалко улетевшего шара…